2025年7月17日

法人向け ChatGPT 導入時に注意すべきセキュリティの落とし穴と安全な活用法とは?

ChatGPTや生成AIの法人利用には情報漏洩やシャドーAIといったセキュリティリスクが潜んでいます。本記事では企業が安全にLLMを活用するための落とし穴と対策を詳しく解説。ENSOUチャットボットによる安心な導入支援も紹介。

近年、 OpenAI ChatGPT 、Google Gemini をはじめとする生成AIや大規模言語モデル(LLM)の進化はめざましく、多くの企業が業務効率化を目的に導入を進めています。

その用途はコーディングや契約書のレビューなどの専門的な内容から、文書作成支援やメールや問い合わせ対応の効率化など、日々広がりを見せています。

一方で、その利便性の裏には、見落とされがちなセキュリティリスクが潜んでいます。導入に先立ち、これらのリスクを正しく理解し、適切な対策を講じなければ、企業の信頼や競争優位性を損なう重大なインシデントに発展する恐れがあります。

本記事では、主にChatGPTを例に挙げながら、法人における生成AI導入時のセキュリティ上の落とし穴とその対処法について詳しく解説します。

法人向けに ChatGPT をセキュリティの懸念なしに使用できるサービス 「ENSOUチャットボット」 を提供しています。興味がある方は以下のリンクからお気軽にお問い合わせください。

生成AI活用におけるセキュリティのリスク

最もよくあるセキュリティ上のリスクは、チャットボットに機密情報を入力してしまうことによる情報漏洩、またそのデータが生成AIモデルの学習に使用されるリスクです。

ChatGPT の無料プランや個人向けのプランでは、デフォルトで学習が有効になっています。

一方で、法人向けの Team プランや Enterprise プランでは、学習対象にしないという設定になっています。

全者的に Team プランなどを導入するのであれば特に問題にはなりませんが、企業の中で一部の従業員に対してのみ、個人向けのプランで ChatGPT の利用を許可しているようなケースでは、学習をさせないためのオプトアウトの設定を有効にすることを徹底しない限り、このリスクが潜んでいます。

特にチャットのメッセージだけではそこまで大掛かりかつ重要な情報が漏洩しない可能性はありますが、メッセージ送信時にファイルアップロードができたり、 GPTs や Projects の機能のナレッジとしてファイルをアップロードするなどであれば、 機密性の特に高い情報が漏洩する可能性があります。

これらに適切に対応をするためには、 Team プランの導入や、 ENSOUチャットボット などの、企業が提供する法人向けのChatGPTサービスなどを利用する必要があります。

シャドーAI 知らずのうちに情報が漏洩する可能性

先ほどの情報漏洩の問題であれば、企業が適切なセキュリティのガバナンスを維持することで対応が可能です。

一方で対処が非常に難しい問題として、従業員が個人の ChatGPT などのアカウントを業務で使用するシャドーAIによる問題が考えられます。

また、弊社でお客様の生成AI活用を支援していく中で、このシャドーAIによる問題は比較的よく見かけるセキュリティリスクのひとつです。

個人で契約したアカウントを業務で使用するとなると、情報システム部や管理部門で検知することが簡単ではないため、企業全体でどのような情報が外部に漏洩しているのかを把握することが難しくなります。

ChatGPT の個人向けプランであれば、デフォルトではモデルへの学習利用を許可する設定になっているため、特に注意が必要です。

このシャドーAIに対処するためには、全社的にセキュアに利用できる生成AIの基盤を構築し、適切な管理のもとで活用を推進していく必要があります。

ChatGPT 個人向けプランの学習を止めるには

ChatGPT の無料プランと個人向けプランは先述の通り、設定を編集しない限りはデフォルトでモデルの学習に使用される設定になっています。

この章ではその設定がどうなっているのかを確認し、学習に利用されないようオプトアウトする方法を記載します。

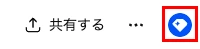

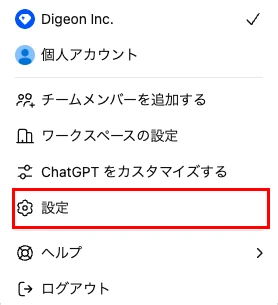

まずは ChatGPT の画面右上にあるユーザーアイコン(画像内の赤枠部分)をクリックします。

次に表示されるモーダル部分から「設定」をクリックします。

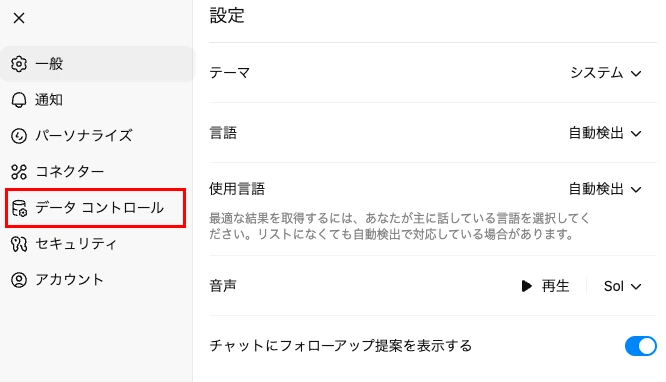

すると画面中央に下記が表示されるため、赤枠部分の「データコントロール」をクリックします。

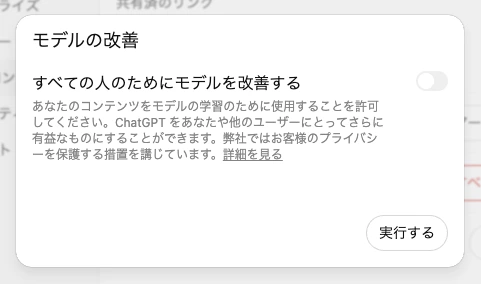

このデータコントロールにおける「すべての人のためにモデルを改善する」のオン・オフが、データが学習に利用されるかを制御する要素です。

上記画像の赤枠部分をクリックし、下記のような画像が表示され、オンになっていればオフに、オフになっていればそのままにすることで、自身の投入したデータが学習されないようになります。

生成AIの法人利用における具体的な対策

個人向けプランの ChatGPT における対策を先ほどの章で記載しました。

本章では、企業としてどのような方針でリスクに対処しながら活用を推進していくかについて記します。

ガイドラインと周知の徹底

まずは生成AI活用に関する社内ガイドラインを定め、従業員に周知を徹底します。

ガイドラインの中身としては、どのサービスが利用できてどのサービスが利用できないのかを、特に利用可能なものに関してはプランも含めて明記します。そして具体的に各サービス毎や共通する部分で、どのような情報を入力してよく、どのような情報を入力していけないか、を定めます。

その後は作成したガイドラインを元に、社内研修を行なって周知を徹底します。

安全に利用できるサービスの検討

安全に ChatGPT を業務で活用するためには、無料プランや個人向けプランではなく、 ChatGPT Team や Enteprise 、もしくは API を用いて提供される法人向けの生成AIサービスの採用を検討するべきです。

これらのプランやサービスではユーザーの入力内容が学習に利用されないことが明記されており、セキュリティ上のリスクを大幅に低減させることができます。

また、APIを利用して法人向けに提供されている生成AIのサービスであれば、対話履歴の確認、アクセスログの監視、利用状況のモニタリングなど、利活用における監査系の機能を有していることが多く、またChatGPTよりも安価に利用できるサービスなどもあります。

APIを利用して内製するかSaaS形式のサービスを利用するか悩まれている方は、こちらの記事を参考にしてみてください。

まとめ

生成AI、とりわけChatGPTのような大規模言語モデルは、業務の生産性や創造性を飛躍的に向上させる可能性を秘めています。しかしその一方で、情報漏洩やシャドーAI、誤情報の生成といったセキュリティリスクも見逃すことはできません。

こうしたリスクを過小評価せず、社内のルール整備・安全なツール選定・従業員への教育といった対策を段階的に進めていくことが、企業としての責任ある生成AI活用につながります。

ChatGPTをはじめとした生成AIを「安心・安全に業務に取り入れる」ためには、単に使わせるだけでなく、組織として活用を設計・管理する体制づくりが欠かせません。まだ導入を検討している段階でも、まずはリスクと対策を正しく理解するところから始めてみてください。

ENSOUチャットボットではじめる生成AI活用

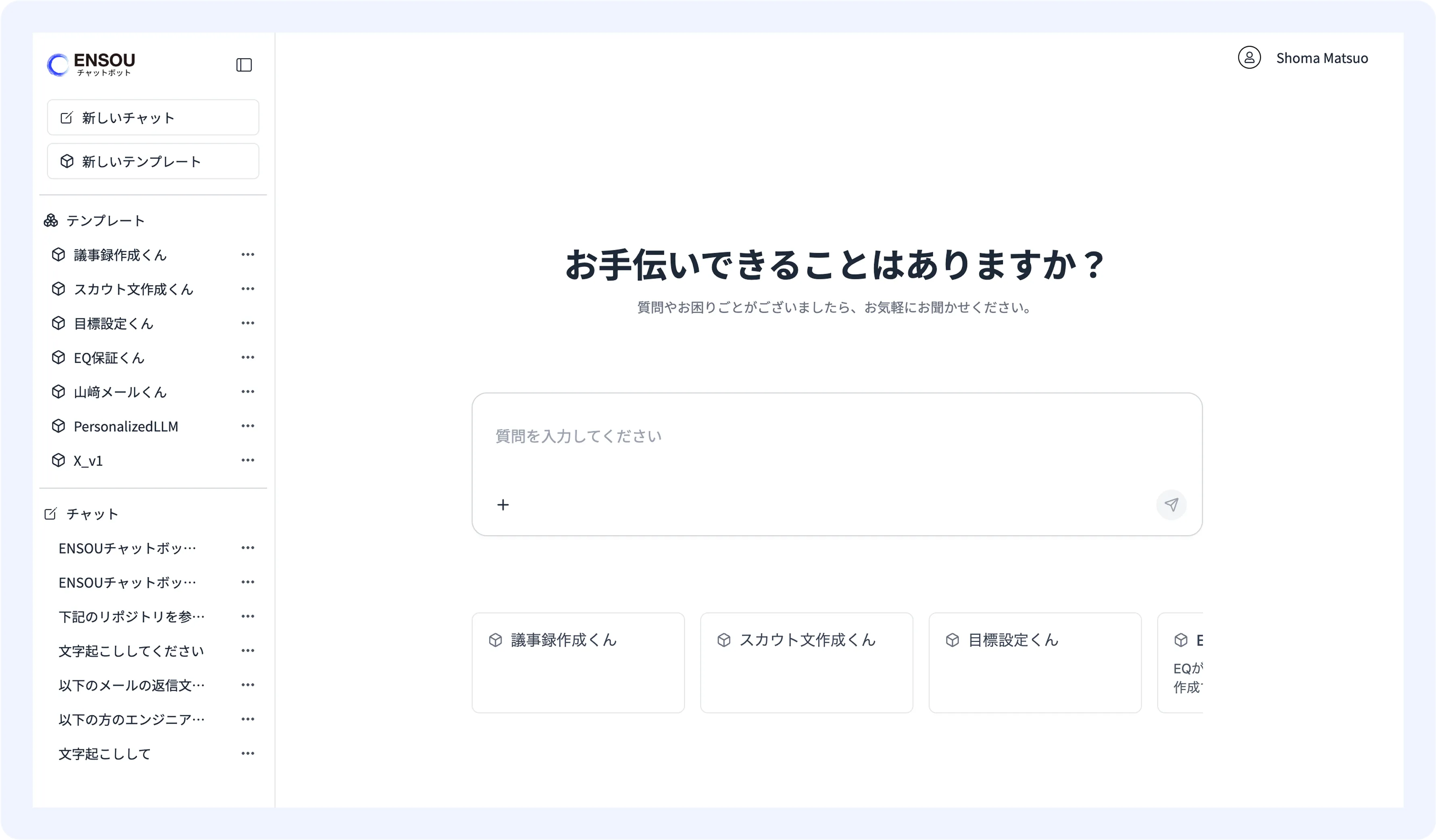

弊社では法人向けにChatGPTをセキュアに使えるサービスである「ENSOUチャットボット」を提供しています。

ENSOUチャットボットでは上記のセキュリティのリスクを気にすることなく、安心して生成AIの活用を始められます。

セキュリティ上重要な対話履歴の確認、アクセスログの監視、利用状況のモニタリングなどの機能もあり、AI活用の基盤として最適なサービスです。

また導入しても社内で使われないという状況を避けるために、活用のコンサルティングサービスもご利用いただけます。実際のどの業務で使えるのか、どんなプロンプトを入力すれば良いのか、といったお悩みがある場合に最適です。

ENSOUチャットボットのご相談、無料トライアルは、以下からお問い合わせください👇